人工智能芯片技术路线深度分析报告

#ai_chip #semiconductor #technology_roadmap #GPU #NVIDIA #AMD #ASIC #chiplet #semiconductor_industry #machine_learning

中性

A股市场

2026年2月13日

解锁更多功能

登录后即可使用AI智能分析、深度投研报告等高级功能

关于我们:Ginlix AI 是由真实数据驱动的 AI 投资助手,将先进的人工智能与专业金融数据库相结合,提供可验证的、基于事实的答案。请使用下方的聊天框提出任何金融问题。

相关个股

NVDA

--

NVDA

--

AMD

--

AMD

--

INTC

--

INTC

--

GOOGL

--

GOOGL

--

TSM

--

TSM

--

ASML

--

ASML

--

AMAT

--

AMAT

--

人工智能芯片技术路线深度分析报告

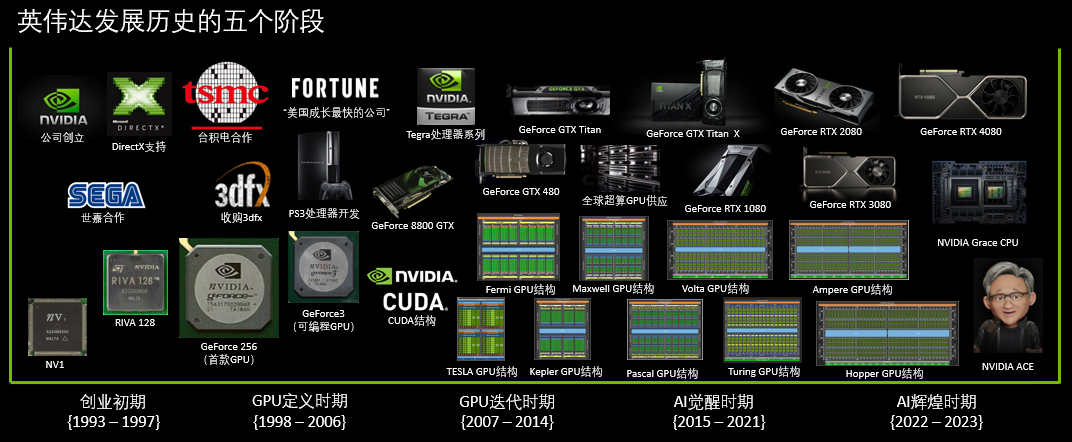

一、技术路线总体演进框架

1.1 发展阶段划分

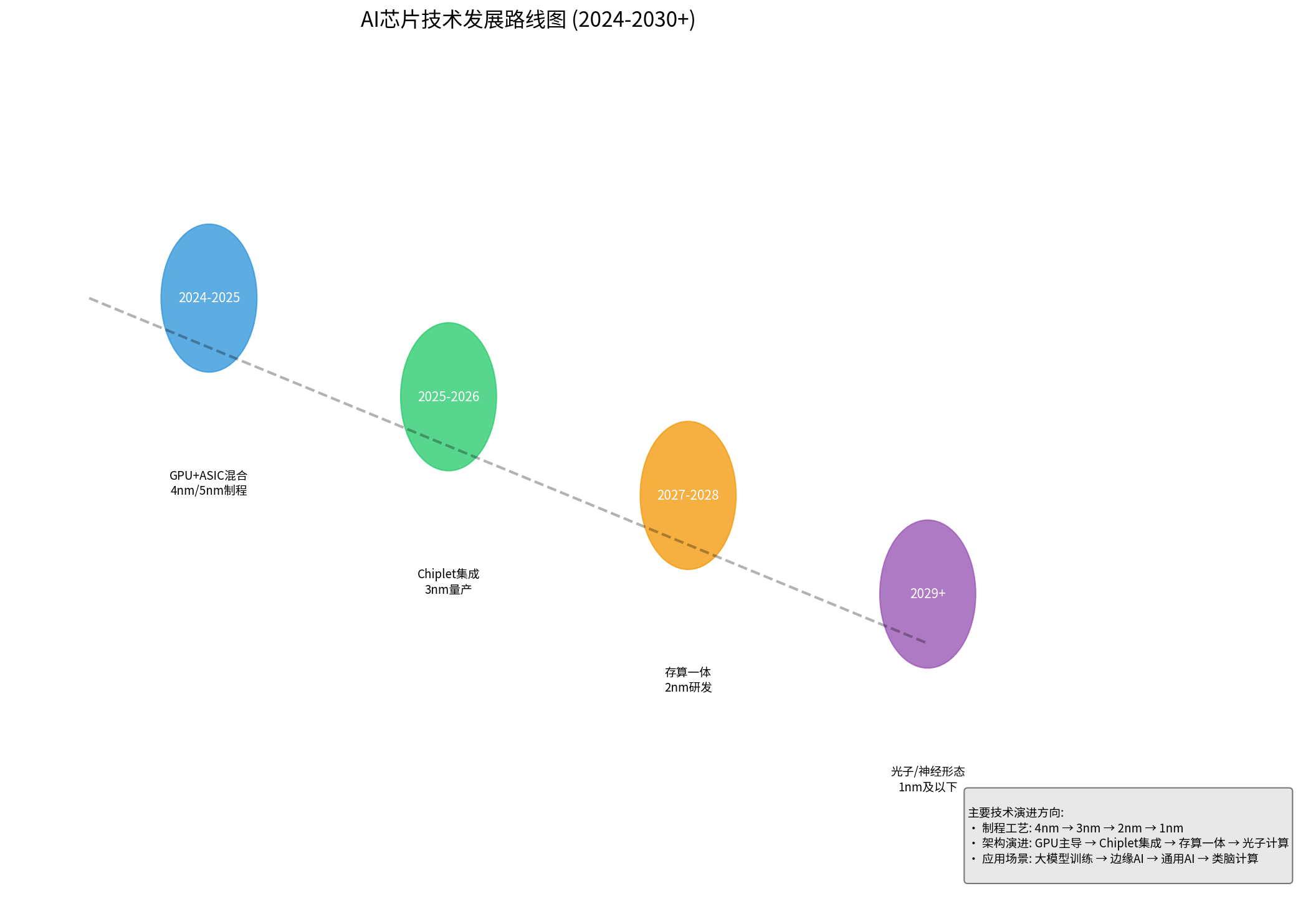

人工智能芯片技术路线可分为四个主要发展阶段,每个阶段都有其独特的技术特征和市场定位:

当前主流阶段(2024-2025年)

:以GPU为主导、ASIC专用芯片协同部署的混合架构模式。NVIDIA凭借CUDA生态系统占据绝对主导地位,采用4nm/5nm先进制程,主要应用于大模型训练和数据中心场景。

近期演进阶段(2025-2026年)

:Chiplet小芯片集成技术成为主流,统一内存架构(HBM3E/HBM4)普及,3nm制程实现量产。应用场景向边缘AI和多模态模型拓展。

中期发展阶段(2027-2028年)

:存算一体(Compute-in-Memory)技术突破"内存墙"瓶颈,2nm制程进入研发阶段。通用AI和具身智能成为主要应用方向。

远期展望阶段(2029年以后)

:光子计算和神经形态芯片走向成熟,1nm及以下制程探索成为可能,类脑计算和量子AI进入早期探索阶段。

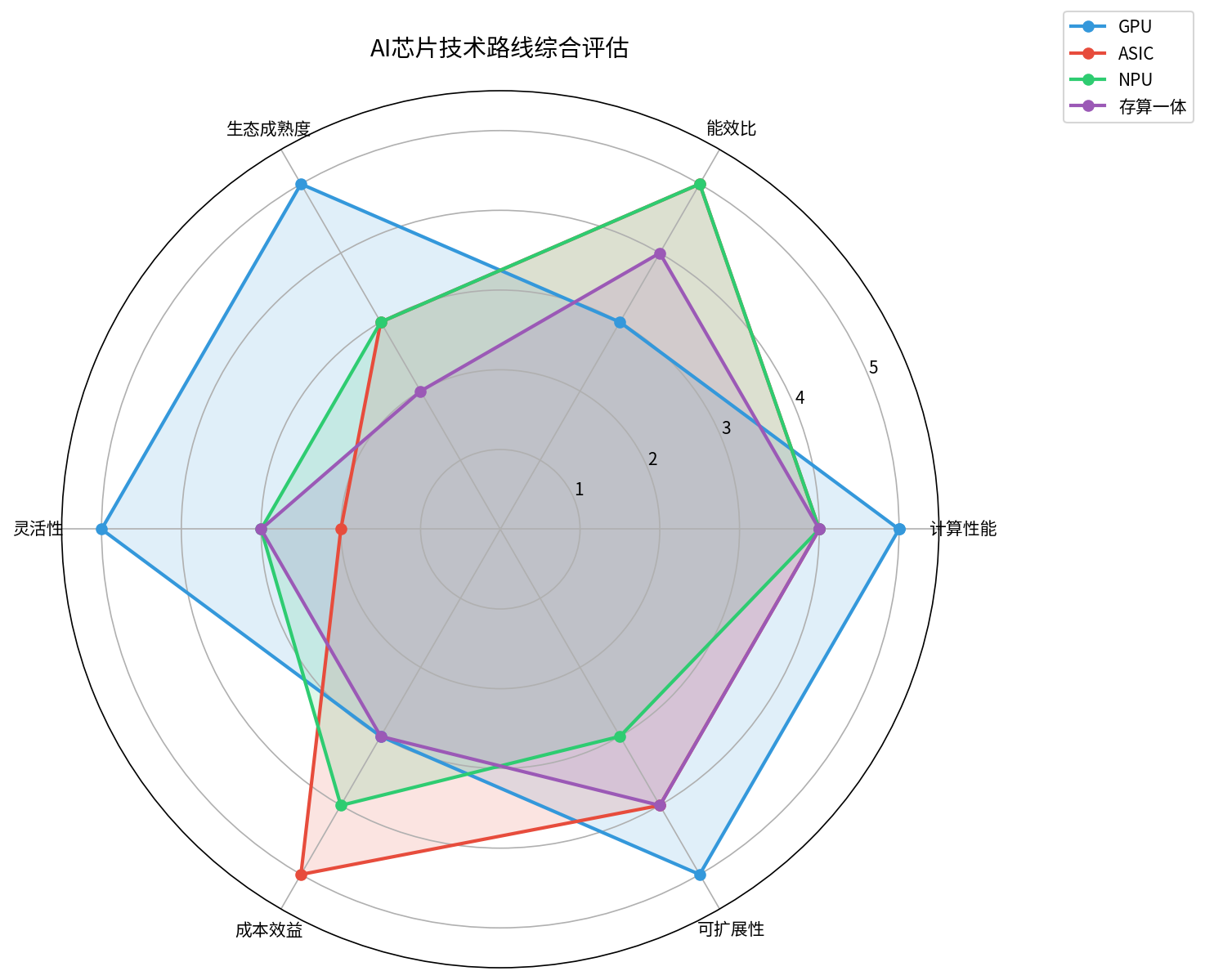

1.2 核心技术路线对比

| 技术路线 | 核心优势 | 主要劣势 | 成熟度 | 适用场景 |

|---|---|---|---|---|

GPU通用加速 |

生态成熟、通用性强、编程灵活 | 功耗高、成本持续上升 | ★★★★★ | 大模型训练、通用AI |

ASIC专用芯片 |

能效比高、单位算力成本低 | 灵活性差、开发周期长 | ★★★★☆ | 推理加速、专用场景 |

NPU神经网络 |

专用优化、推理效率高 | 适用范围窄、依赖算法 | ★★★★☆ | 边缘推理、终端部署 |

存算一体 |

突破内存墙、高带宽 | 技术成熟度低、产业化难 | ★★★☆☆ | 大模型推理、数据密集型 |

光子计算 |

超高速传输、极低功耗 | 产业化困难、规模有限 | ★★☆☆☆ | 特定高速场景 |

神经形态 |

事件驱动、超低功耗 | 算法适配难、商业化初期 | ★★☆☆☆ | 传感网络、低功耗终端 |

二、关键技术突破方向

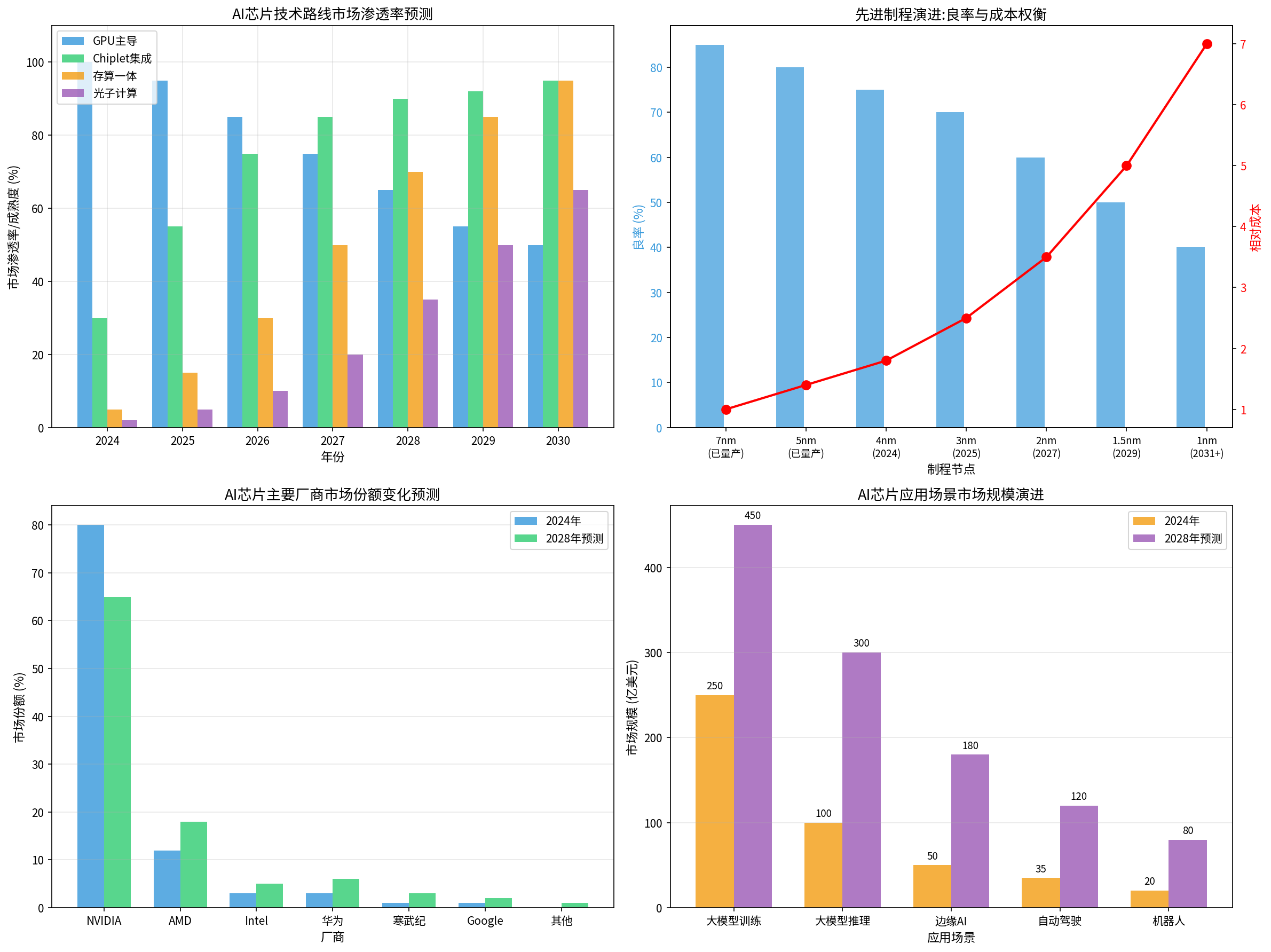

2.1 制程工艺演进

先进制程是AI芯片性能提升的核心驱动力之一。当前主流AI芯片已推进至4nm/5nm节点,其中:

- 4nm制程:NVIDIA Blackwell架构、AMD CDNA3架构采用台积电4nm工艺,实现更高的晶体管密度和能效比

- 3nm制程:2025年进入量产阶段,预计2026年成为AI芯片主流工艺

- 2nm及以下:面临物理极限挑战,需依赖GAA晶体管、CFET等新型器件架构

关键挑战

:随着制程微缩,良率下降问题日益突出。数据显示,7nm制程良率约85%,而1nm节点良率可能降至40%以下,这直接导致芯片成本大幅上升[0]。

2.2 架构创新路线

GPU架构持续演进

:NVIDIA的Blackwell架构引入第五代Tensor Core,支持FP4和FP8精度切换,AI性能相比Hopper架构提升数倍。AMD的CDNA3架构采用Chiplet设计,实现更高的灵活性和成本效益。

Chiplet集成技术

:通过将计算核心、内存、I/O等模块解耦为独立小芯片,再通过先进封装技术集成,可突破单一光罩的尺寸限制,同时降低研发成本和周期。UCle(Universal Chiplet Interconnect Express)标准的制定正在推动行业互联互通。

存算一体技术

:解决"冯·诺依曼架构"瓶颈的核心路径。通过将计算单元嵌入存储阵列中,大幅减少数据搬运功耗和延迟。预计2026-2027年可实现商业化产品落地。

2.3 内存系统革新

HBM(高带宽内存)演进

:HBM3E已成为当前AI芯片标配,提供超过1TB/s的带宽。下一代HBM4将进一步提升带宽至1.5TB/s以上,同时降低功耗。

CXL(Compute Express Link)协议

:实现CPU、内存、AI加速器之间的统一内存池化,解决内存碎片化问题,提升系统整体效率。

三、主要厂商技术布局

3.1 国际巨头

| 厂商 | 核心技术路线 | 制程工艺 | 竞争优势 | 目标市场 |

|---|---|---|---|---|

NVIDIA |

GPU架构+CUDA | 4nm/5nm | CUDA生态完善、数据中心领先地位 | 大模型训练、数据中心 |

AMD |

CDNA架构+Chiplet | 5nm/3nm | 高性价比、开源ROCm生态 | 数据中心、边缘计算 |

Intel |

XPU战略+Falcon Shores | Intel 4/3nm | 先进封装能力、CPU整合优势 | 数据中心、PC终端 |

Google |

TPU脉动阵列 | 4nm/3nm | 云端训练效率、TPU集群规模 | Google Cloud、AI研究 |

NVIDIA市场表现分析

[0]:

- 市值:4.61万亿美元(2026年2月)

- 当前股价:189.50美元

- 数据中心收入占比:87.9%(Q2 FY2026)

- 近一年涨幅:44.50%

- 分析师共识:买入(目标价272.00美元,上涨空间43.5%)

AMD市场表现分析

[0]:

- 市值:3389亿美元

- 当前股价:207.86美元

- 数据中心收入占比:52.4%

- 近一年涨幅:86.05%

- 分析师共识:买入(目标价300.00美元,上涨空间44.3%)

3.2 中国厂商

| 厂商 | 技术路线 | 现状与挑战 |

|---|---|---|

华为 |

昇腾架构+达芬奇架构 | 7nm制程受限,依赖国产替代生态建设 |

寒武纪 |

Cambricon MLU | 专注推理场景,国内AI芯片先行者 |

海光信息 |

DCU架构 | 兼容CUDA生态,受益于国产替代 |

壁仞科技 |

通用GPU | 新晋厂商,产品尚在验证阶段 |

四、应用场景与技术路线匹配

4.1 市场规模与技术需求

| 应用场景 | 推荐技术路线 | 市场规模(2025) | 关键技术指标 |

|---|---|---|---|

| 大模型训练 | GPU集群(NVLink互联) | 300亿美元 | FP8/FP16算力、互联带宽 |

| 大模型推理 | GPU/ASIC/NPU混合 | 150亿美元 | 吞吐量、延迟 |

| 边缘推理 | NPU/边缘GPU | 80亿美元 | 能效比、成本控制 |

| 自动驾驶 | 专用AI芯片 | 50亿美元 | 低延迟、功能安全 |

| 机器人 | 异构计算平台 | 30亿美元 | 实时性、多模态处理 |

| 科研计算 | GPU+专用加速器 | 40亿美元 | 双精度、大内存 |

4.2 技术演进趋势

从市场渗透率预测来看[0]:

- GPU主导:从2024年的100%逐步下降至2030年的50%,但绝对规模仍在扩大

- Chiplet集成:快速从30%增长至95%,成为未来十年的主流封装技术

- 存算一体:从5%起步,预计2030年达到65%,将成为游戏规则改变者

- 光子计算:仍处于早期探索阶段,2030年渗透率约25%

五、投资启示与风险提示

5.1 产业链投资机会

- 上游设计环节:关注具有架构创新能力的企业,如NVIDIA、AMD

- 制造封测环节:台积电先进制程、通富微电等先进封装厂商

- 设备材料环节:ASML(EUV光刻机)、应用材料等

- 下游应用:大型云厂商、AI企业

5.2 主要风险因素

- 技术路线不确定性:存算一体等新技术可能颠覆现有格局

- 地缘政治风险:先进制程设备出口管制影响产能

- 市场需求波动:AI资本支出周期可能导致需求波动

- 成本压力:先进制程良率问题推高芯片成本

5.3 行业展望

AI芯片正处于技术路线变革的关键窗口期。短期内(2025-2026年),GPU仍将主导数据中心训练市场,Chiplet和先进封装成为差异化竞争关键。中期(2027-2028年),存算一体技术有望突破"内存墙"瓶颈,重新定义AI芯片架构。长期来看(2029年以后),光子计算和神经形态芯片可能开启AI芯片的范式变革。

建议投资者密切关注技术演进动态,重点布局具有架构创新能力和生态优势的企业。

参考文献

[0] 金灵API市场数据 - NVIDIA、AMD公司概况与财务数据

[1] TrendForce - AI芯片市场分析与预测报告

[2] 台积电先进制程路线图与技术论坛

[3] NVIDIA GTC开发者大会技术发布

[4] AMD数据中心产品发布会

相关阅读推荐

暂无推荐文章

基于这条新闻提问,进行深度分析...

数据基于历史,不代表未来趋势;仅供投资者参考,不构成投资建议

关于我们:Ginlix AI 是由真实数据驱动的 AI 投资助手,将先进的人工智能与专业金融数据库相结合,提供可验证的、基于事实的答案。请使用下方的聊天框提出任何金融问题。

相关个股

NVDA

--

NVDA

--

AMD

--

AMD

--

INTC

--

INTC

--

GOOGL

--

GOOGL

--

TSM

--

TSM

--

ASML

--

ASML

--

AMAT

--

AMAT

--